- Horyzont.ai

- Posts

- 🎥 Sora: Jak naprawdę działa + dostęp do zaktualizowanego Kursu ChatGPT: Od Zera Do Prompt Inżyniera

🎥 Sora: Jak naprawdę działa + dostęp do zaktualizowanego Kursu ChatGPT: Od Zera Do Prompt Inżyniera

PLUS: Nauka języka z ChatGPT dzięki rozmowom głosowym

🗓 Czwartek 22.02

Witaj w kolejnym wydaniu Horyzont.ai, Twojego kompasu w świecie sztucznej inteligencji.

Nasz newsletter pomoże Ci zacząć korzystać z AI na co dzień oraz nadążyć za nieustannymi nowościami.

~Jakub i Oskar

🔉 Wolisz wersję audio? Nie możesz teraz tego przeczytać?

🔗Przesłuchaj tutaj🔗

🎯 W DZISIEJSZYM WYDANIU

🎓 AI od zera do zrozumienia: Jak w zasadzie działa Sora?

🤖 AI w praktyce: Zaktualizowany kurs ChatGPT od Zera do Prompt Inżyniera i nauka języków obcych z ChatGPT!

🎓 Twoje Ćwiczenie: W tym tygodniu skupiamy się na ChatGPT. Jest to narzędzie, które chcemy, aby każdy kto nas obserwuje znał w 100%!

🔉 Wersja audio: Przesłuchaj tutaj

📚 Rekomendowana Biblioteka: Świetne wykłady Andreja Karpathego z OpenAI.

🕓 Czas czytania: 6min 26s

AI Od Zera Do Zrozumienia 🎓

Sora - jak naprawdę działa.

Kobieta spacerująca po ulicach Tokio, pies pracujący na laptopie, mamuty wyglądające jak żywe i wiele więcej – te oraz inne niezwykłe filmy prawdopodobnie zalały Twoje media społecznościowe.

Sora, model generowania wideo na dużą skalę, jest najnowszym osiągnięciem OpenAI, które wywołało prawdziwą burzę w sieci. Zagłębimy się w temat, który ostatnio wzbudza mnóstwo emocji i nieporozumień: jak właściwie działa Sora?

Jedna z teorii twierdzi, że za wszystkim stoi tajemniczy silnik gry, Unreal Engine. Niektórzy utrzymują, że to wszystko dzieje się dzięki jakiejś magii, inni, że to po prostu chwyt marketingowy OpenAI. Cóż, prawda jest nieco inna, ale dla nas równie fascynująca.

Zacznijmy od początku: co tak bardzo nas zaintrygowało?

W chwili, kiedy najnowsze klipy wideo generowane przez Sorę zaczęły przyciągać uwagę szerokiej publiczności, specjaliści i entuzjaści sztucznej inteligencji skupili się na pewnym ważnym dokumencie. Mowa o publikacji OpenAI zatytułowanej "Video generation models as world simulators"

Nie musisz od razu zagłębiać się w całość tej publikacji – od tego masz nas.

Co czyni Sore tak przełomową?

Stworzenie sztucznej inteligencji, która może wiernie odtwarzać złożoną rzeczywistość naszego świata, zawsze stanowiło wyzwanie. Na temat tego pisałem nieco więcej w moim ostatnim poście dotyczącym modelu opracowywanego przez Meta.

Różnica między prostym, statycznym obrazem a dynamicznym wideo jest ogromna – wideo zawiera elementy takie jak zmiany zachodzące w czasie, trójwymiarowa przestrzeń, interakcje fizyczne i ciągłość obiektów. Co więcej, dotychczasowe systemy nie miały wewnętrznego „zrozumienia” takich koncepcji jak fizyka, przyczynowość czy trwałość obiektów, które są niezbędne do stworzenia realistycznych symulacji świata.

Lista wyzwań jest długa, a wcześniejsze modele AI po prostu sobie z tym nie radziły – ich wideo były często niewyraźne i pełne błędów.

Ale Sora? To zupełnie inna historia. Filmiki wyglądają jak prawdziwe. Czy to kobieta przechadzająca się po ulicach Tokio, czy ptak poruszający skrzydłami – wszystko wygląda naturalnie. A to wszystko dzięki innowacyjnemu podejściu do reprezentacji wideo.

Jak to działa?

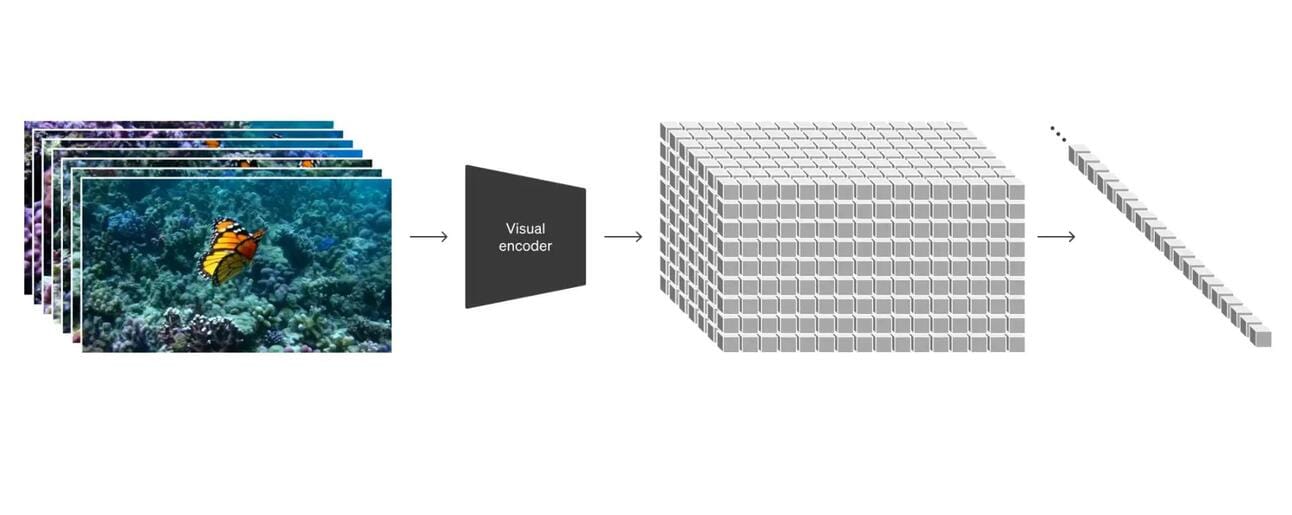

Kluczową innowacją jest sposób, w jaki Sora reprezentuje wideo podczas treningu. Zamiast postrzegać wideo jako jeden długi ciąg, Sora dzieli je na mniejsze fragmenty – podobnie jak model językowy, taki jak GPT-4, dzieli tekst na tokeny. Dzięki temu model może uczyć się na podstawie filmów o różnej długości i jakości, niezależnie od ich pierwotnego formatu.

Tutaj pojawia się istotna kwestia, która budzi nasze zainteresowanie: w raporcie technicznym brakuje szczegółowych informacji na temat zbiorów danych treningowych. Mówiąc potocznie, nie znamy szczegółów dotyczących filmów, które OpenAI użyło do trenowania Sory, podczas gdy w przypadku ostatnio omawianego przez nas modelu V-JEPA, Meta wykorzystała między innymi filmy instruktażowe typu 'How to'.

Architektura Modelu

Sora korzysta z architektury transformatora, która jest ściśle związana z modelami GPT, aby przetwarzać długie sekwencje tych fragmentów wideo. Transformatory, o których obszernie pisaliśmy tutaj, wykazały się niezwykłą zdolnością skalowania w różnorodnych dziedzinach, takich jak modelowanie językowe, wizja komputerowa czy generowanie obrazów.

OpenAI udowodniło, że transformatory dyfuzji skutecznie radzą sobie również jako modele wideo. Poniżej przedstawiamy porównanie próbek wideo z ustalonymi punktami odniesienia i danymi wejściowymi, w miarę postępów treningu. Jakość próbek znacząco się poprawia, gdy wzrasta moc obliczeniowa przeznaczona na trening.

Kondycjonowanie tekstem

Trening systemów generujących wideo z tekstu wymaga dużej ilości filmów z odpowiadającymi im tekstowymi opisami. Wykorzystuje się tutaj technikę ponownego opisywania, wprowadzoną w modelu DALL·E 3, ale tym razem stosowaną do wideo. Najpierw trenuje się model, który tworzy szczegółowe opisy, a następnie używa go do generowania tekstowych podpisów dla wszystkich filmów w zestawie treningowym. Okazuje się, że trening na szczegółowych opisach wideo poprawia zgodność tekstu oraz ogólną jakość wideo.

Podobnie jak w DALL·E 3, wykorzystuje się również GPT do przekształcenia krótkich poleceń użytkownika w dłuższe i bardziej szczegółowe opisy, które są następnie przekazywane do modelu wideo. Umożliwia to generowanie wysokiej jakości filmów, które dokładnie odpowiadają poleceniom użytkowników.

Co potrafi Sora?

To, co najbardziej wyróżnia Sora, to nie tylko generowanie wideo z tekstu. Model ten potrafi tworzyć realistyczne sceny 3D, zachowując ciągłość obiektów, nawet jeśli chwilowo znikną z kadru. Może na przykład symulować, jak malarz tworzy kolejne pociągnięcia pędzlem na płótnie – i wszystko to w oparciu o ogromne ilości danych, bez żadnych kodów graficznych.

Ograniczenia

Ale Sora nie jest doskonała. Nadal ma problem z bardziej złożonymi interakcjami fizycznymi i może czasem "zgubić" wątek w bardziej zatłoczonych scenach.

Prosta fizyka i właściwości obiektów wciąż stanowią wyzwanie. Na przykład, scenariusz z przewracającą się i rozlewającą szklanką pokazuje szkło, które topnieje w stół, a ciecz wyskakuje przez boki szklanki bez żadnego efektu rozbijania.

Mimo to, jej możliwości są imponujące i wskazują kierunek, w którym zmierza przyszłość generowania wideo.

Podsumowanie

Zatem, mimo dzikich teorii krążących po sieci, Sora nie jest ani czarodziejką, ani nie jest oparta na tajemniczym silniku gry. Jest to po prostu kolejny krok w ewolucji sztucznej inteligencji – krok, który ma potencjał do zrewolucjonizowania sposobu, w jaki tworzymy i postrzegamy wideo. Oczywiście, wraz z rozwojem tej technologii pojawią się nowe wyzwania, nad którymi będziemy musieli zapanować, takie jak coraz bardziej powszechne deepfake'i.

Dlatego niezwykle ważne jest, aby edukować nie tylko siebie, ale także innych wokół nas. Jeśli chcesz przyczynić się do naszej misji, prosimy o udostępnienie poniższego linku do naszego newslettera wśród znajomych. To nic nie kosztuje, a w ten sposób pomagasz nam dotrzeć do większej liczby osób w Polsce.

📬️ Newsletter Horyzont.ai 🙏

AI w Praktyce 🤖

Aktualizacja kursu ChatGPT: Od Zera Do Prompt Inżyniera

Pamiętasz nasz pierwszy kurs ChatGPT? Teraz dostał aktualizacje, dodaliśmy tam mega pigułkę wiedzy na temat korzystania z ChatGPT - z nami opanujesz AI, zanim ono opanuje Ciebie.

Do tego czekają tam na Ciebie dodatki w postaci szablonu do Notion do zapisywania promptów i generatora promptów dostępnego na naszej stronie!

📚️ Dostęp do kursu 🧰

ChatGPT Voice - wiesz, że AI ma potencjał nauczenia Cię języków obcych?

W tym poradniku nauczysz się korzystać z ChatGPT, w taki sposób, aby nauczył Cię języka obcego. Wykorzystaliśmy tam naukę języka poprzez rozmowę z native speakerem. Nic nie nauczy Cię języka lepiej niż rozmowa z kimś, kto perfekcyjnie włada tym językiem.

Twoje Ćwiczenie

Ten tydzień poświęcamy zupełnie ChatGPT. Nie dostrzegamy jego wielkiej mocy i tego, że mamy tę moc na wyciągnięcie ręki, w smartfonie.

Mamy nadzieję, że dzisiejsze poradniki Ci się przydadzą. Jeśli chciał(a)byś żebyśmy zrobili poradnik na temat jakiegoś zastosowania, to śmiało odpowiedz na tego maila!

Biblioteka 📚

Let’s Build A GPT Tokenizer

Autor: Andrej Karpathy - były pracownik OpenAI, słynie z tego, że potrafi przedstawić skomplikowane zagadnienia, w prosty, przyswajalny sposóbOpis: Andrej buduje GPT Tokenizer, czyli komponent Dużych Modeli Językowych odpowiadający za to, że na przykład ChatGPT jest słaby z matematyki.

Stanford CS25: V2 I Wstęp do Transformerów w/ Andrej Karpathy

Autor: Andrej Karpathy - były pracownik OpenAI, słynie z tego, że potrafi przedstawić skomplikowane zagadnienia, w prosty, przyswajalny sposób

Opis: Podczas wykładu na Stanford University, Andrej wyjaśnia jak działają transformatory, czyli to jak działa ChatGPT.

Zareklamuj swój produkt!

Zasponsoruj kolejne wydanie newslettera!

Czyta nas ponad 2000 osób zainteresowanych AI z różnych sektorów: ludzie z branży technologicznej, przedsiębiorcy, inwestorzy, managerowie, CEO firm!

Napisz do nas!

To na tyle!

Jeśli masz jakieś ekscytujące pomysły lub projekty, śmiało się z nami skontaktuj, odpowiadając na ten email lub śledząc nas na

X: @JakubNorkiewicz

LinkedIn: @OskarKorszen

💙 Ocena tygodnia:

Do zobaczenia w następnym wydaniu!

~Jakub I Oskar

Reply